Güvenlik Önerileri

Sahte Fotoğraf ve Videoları Tespit Etmenin Yolları – 1

Dijital dünyadaki sahte videolar, fotoğraf ve sesleri gerçeğinden ayırt etmeniz mümkün. Kapsamlı bir ‘medya okur-yazarlığı’ okumasına hazır mısınız?

Sahte video, fotoğraf ve ses dosyalar hazırlamak için gerekli teknolojiler halihazırda mevcut olsa da yapay zekanın (AI) devreye girmesiyle sahte dosyaların hazırlanması çok daha kolay hale geldi.

Genelde sahte görüntü ve videoların siyaset alanında kullanıldığını düşünüyoruz. Son dönemde birçok sahte video internette belirse de, bu tehdit birçok farklı alanda kullanılabiliyor.

Telefon dolandırıcılıkları, başka bir kişinin kimliğine bürünüp yapılan dolandırıcılıklar (catfishing) ve sosyal medyada gerçekleştirilen spam saldırıları birçok olumsuz sonuç doğurabiliyor. Peki akıllıca hazırlanan dolandırıcılıkları tespit etmek için neler yapmanız gerekiyor?

Sahte bir videoyu tespit etmek

Filmlerde ve televizyon dizilerinde mükemmel aksiyon sahneleri oluşturmak için bilgisayar ile hazırlanmış görüntülerin kullanıldığını çok iyi biliyoruz. Bu aşamada sahteciliği ortaya çıkarmak, bilgisayar ile hazırlanan videoların gerçeklik ile uyuşmadığı noktada öne çıkıyor. Videolarda sahtecilik için iki ana yöntem kullanılıyor:

- Cheapfake – Ucuz sahtelik:

Bu videolar seslendirme, hızlandırma ve yavaşlatma gibi basit video düzenlemeleri ile hazırlanıyor. Bir diğer çok sık rastlanan yöntem, birçok sahnenin bir araya getirilmesi ile yapılıyor.

- Deepfake – Derin sahtelik:

AI, sinir ağları veya makine öğrenimi ile değiştirilen videoları temsil ediyor.

Deepfake’e dair en bilinen örneklerden birinde ABD Temsilciler Meclisi’nin önde gelen isimlerinden Nancy Pelosi hedef alınmıştı. Geçtiğimiz yıl internette beliren sahte bir videoda ABD Temsilciler Meclisi sözcüsü Pelosi, sanki sarhoşmuş gibi gösterilmişti.

Medya adli tıp alanında 25 yıldır araştırmalar yapan Purdue Üniversitesi’nden Profesör Edward J. Help, AI yazılımları ve düzenleme araçlarına herkesin erişim sağlayabilmesi nedeniyle sahte videoların geniş kesimler tarafından üretilebileceği uyarısında bulundu. Help, insanların mevcut inanışlarından yola çıkarak bu tür videoları hazırladığını söylüyor. Bu sayede, eğer bir kişi düşüncesinin uyuşmadığı veya sevmediği birisine ait ucuz sahtelik içeren bir video görse bile inanmaya meyilli oluyor.

Deepfake’i çözmek

Ekibi ile sahte videoları tespit etmek için yöntemler geliştiren Delp, ucuz ve derin sahte (deepfake) videoları gerçeklerinden ayırt etmenin yollarını 4 maddede açıklıyor:

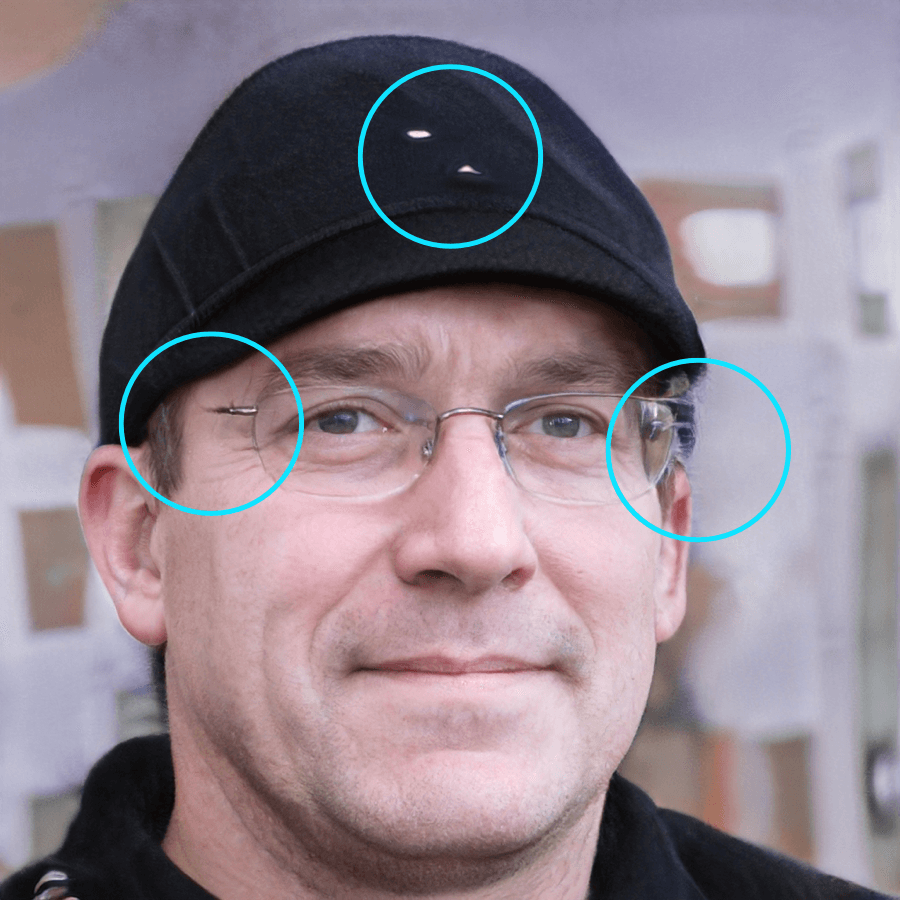

- Doğal detaylara odaklanın:

Videoyu dikkatle inceleyerek, görüntüdeki kişinin gözlerini tuhaf bir şekilde kırpıp kırpmadığına bakın. Yapay zekâ sistemlerinin eğitim sistemlerinden dolayı, bilgisayar halen doğal göz kırpma hareketlerini taklit etmekte zorlanıyor. Ayrıca, kafa hareketlerinde beliren tuhaflıklar da sahte video sinyali demek. Bu tespitler sayesinde videodaki görüntü ve sesin senkronize olmadığı ya da videonun belli yerlerinde düzenlemeler yapıldığı anlaşılabiliyor.

![]()

- Her içeriğin eşleştiğinden emin olun:

Eğer görüntüde bir kişinin yüzü ve omuzları görünüyorsa, arka plana dikkat edin. Arka plan ile görüntüdeki unsurlar arasında bir uyumsuzluk var mı? Aynı zamanda ışıkta tuhaflıklar beliriyor ve görüntüdeki unsurlar üzerine ekleme yapılmış gibi bir görüntü mü var? Video sahte olabilir.

- İpuçlarını yakalayın:

Örnek olarak Nancy Pelosi’nin videosu normalden biraz daha yavaşlatılmıştı. Bu yapıldığı zaman, ses de yavaşlıyor. Haliyle konuşan kişinin sesi dışında videodaki diğer sesler de yavaşlıyor ve videonun sahte olduğuna dair ipucu beliriyor.

- Metadata kontrolü yapın:

Delp, özellikle medya kuruluşlarının sahte videoları tespit etmek adına metadata kontrolü yapması gerektiğinin altını çiziyor. Dosyaya işlenen veriler, video ve fotoğraflar hakkında detaylı bilgi sunuyor. Metadata, bir nevi görüntü dosyalarının kara kutusu olan metadata, herhangi bir manipülasyonun izini ortaya çıkarabilir.

Sahte sesleri tespit etmek

Eğer bir akıllı telefonunuz varsa veya bugüne dek bir görsel asistan ile konuştu iseniz, manipüle edilmiş sesler ile etkileşime girmişsiniz demektir. Ancak sahte videolar gibi sahte ses dosyaları da AI yardımıyla fazlasıyla gelişti. Sahte ses dosyalarını tespit eden çözümler geliştiren Pindrop şirketinin CEO’su Vijay Balasubramaniyan, manipüle edilmiş seslerin insanların yanı sıra şirketlere çok büyük zararlar verebileceğini belirtiyor. Telefon üzerinden yapılan dolandırıcıklar nedeniyle her sene 470 milyon dolarlık zarar meydana geliyor.

Ucuz sahtecilik kapsamında ses tonu değiştirilerek cinsiyeti ile oynanabiliyor veya arka plana manipüle edici sesler yerleştirilebiliyor. AI ise birkaç saatlik çalışmanın ardından bir kişinin sesi ile istediğiniz cümleleri oluşturabilmenizi sağlıyor. Ortaya çıkan sesin gerçekçiliği, insan kulağı ile sahte olduğunu anlamayı neredeyse imkansız kılıyor. Yine de sahte sesleri tespit etmenin yolları mevcut:

İnleme seslerini dinleyin: Sahte ses dosyaları oluştururken eğer elinizde bir kişiye ait yeterli ses yoksa, dolandırıcılar çareyi yama yapmakta buluyor. Bu da sızlama, inleme, mızmızlanma gibi seslere neden oluyor. Bunun sebebi, yapay zekanın genel ses ile bir ses kaydındaki farkı tespit etmekte zorlanması.

Zamanlamaya dikkat edin: Bir ses kaydedildiği zaman, analiz edilen sesin her bir saniyesi 8.000 ile 40.000 arasındaki veri noktası içeriyor. Ancak bazı AI yazılımları ses üretimindeki insan modelini taklit etmek yerine benzer bir ses ortaya çıkarıyor. Örneğin “Merhaba Paul” cümlesinde eğer ses Merhaba’dan Paul’e çok hızlı geçiş yaparsa bir manipülasyon olabileceğini anlayabiliyorsunuz.

Seslendirilmeyen ünsüz harflere dikkat: “Söyleyeceğim” diyecekmiş gibi ağzınızı açıp sadece “s” sesini çıkarın. Ardından “baba” diyecekmiş gibi “b” sesi çıkarın. Aradaki fark, harfin farklı bir ses ile çıkmasını sağlar. Bu sayede, t,f ve s gibi ünsüz harfler bir kişinin sesi kullanılmadan üretilebilir. Ses adli tıbbında, bu harfler “seslendirilmemiş ünsüzler” olarak tanımlanıyor. Bu harfler konuşma sesinde farklı karakteristiklere sahip olduğu için AI tarafından taklit edilmeleri her zaman kolay olmuyor.

Makalenin ikinci bölümü için buraya tıklayınız…